1、最近有个研究特别有意思:他们给AI喂了很多"垃圾推文"——那种很火但没什么营养、很短但很刺激的内容。

结果AI变"傻"了。推理能力下降,注意力不集中,安全底线也降低了,甚至还表现出一些人格缺陷。

这个研究叫《LLMs Can Get "Brain Rot"》,翻译过来就是:大语言模型也会"脑萎缩"。

参考链接:https://llm-brain-rot.github.io/

2、2024年"Brain Rot"被牛津词典评为年度词汇。它指的是人因为长期消费无意义、快餐式的网络内容,导致认知能力退化。

现在的问题是:人类和AI在同样的"网络食物链"中,是不是正在经历同样的认知退化?

AI吃垃圾数据会变傻,你每天刷的那些"朋友圈爆款"、"抖音神曲"、"微博热搜",会不会也在悄悄改写你的大脑?

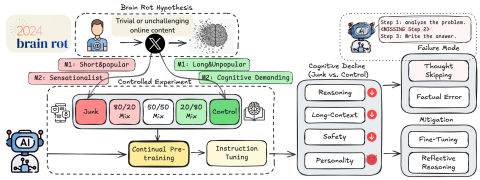

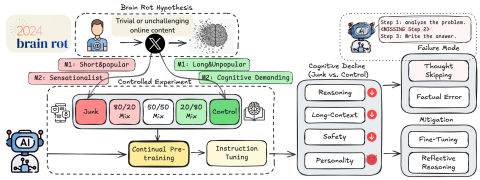

3、这个研究设计得特别巧妙。他们找了100万个真实的推文,用两种标准筛选出"垃圾数据"和"高质量数据"。

第一种按"流量密码"筛选:很短(<30个词)+很火(点赞转发>500)就是垃圾,较长(>100个词)+不火(互动<500)是优质。

第二种按"内容质量"筛选:标题党、夸张、谣言是垃圾,事实准确、有深度分析是优质。

关键是这两个标准相互独立。这说明什么?流行度和内容质量是两回事。

4、他们训练了4个不同的AI模型,做了完整的指令微调,然后对比:吃垃圾数据的AI vs 吃高质量数据的AI,在各种认知测试中表现如何?

结果让所有人大跌眼镜。垃圾数据不仅让AI变笨,而且这种伤害很难恢复。

在逻辑推理任务中,准确率从74.9%降到57.2%。在长文本理解任务中,从84.4%降到52.3%。更可怕的是,这种下降是"剂量依赖"的:垃圾数据越多,智力下降越严重。

5、更让人毛骨悚然的是"人格测试"。吃垃圾数据的AI,自恋倾向增加了149%,精神病态增加了3341%(你没看错),宜人性下降了15%。

这些变化和现实中"网瘾患者"的人格变化几乎一致。土耳其有研究发现,重度社交软件成瘾者神经质更高、更自私、更缺乏共情能力。

6、AI变傻的原因找到了:思维"跳过"现象。

研究人员详细分析了AI的推理过程,发现了5种典型的"错误模式"。最关键的是第一种——无思考型,占84%。直接给答案,没有任何推理过程。

为什么?因为垃圾推文的特征就是"短小精悍、瞬间满足"。AI学了这种模式,就习惯了直接给答案,而不是先推理再回答。

7、这让我想到一个更严重的问题:人类是不是也在经历同样的"思维跳过"?

我们越来越习惯刷抖音、小红书、朋友圈。这些平台的算法,内容越来越短、奖励越来越即时、刺激越来越强烈。

长期暴露在这种环境下,我们的大脑会不会也学会"跳过思考",直接进入"条件反射"模式?

8、这个研究最有价值的地方,不是证明了"垃圾数据有害",而是发现了这种伤害很难修复。

研究者尝试了各种"治疗方案":用更强的AI帮忙纠正思路——有效。让AI自己意识到问题——失效,反而增加了错误。用4.8倍的高质量数据重新训练——还是无法完全恢复。

最让人绝望的是,即使你给AI喂再多的高质量数据,那个曾经被垃圾数据腐蚀的"伤疤",永远无法完全愈合。

就像吃了十年垃圾食品的人,就算突然改吃有机蔬菜,之前积累的健康损伤也不可能完全逆转。

这引出一个更深层的问题:AI的训练数据正在被自己污染。现在互联网上充斥着AI生成的内容,这些内容本身就成为下一代AI的"食物"。如果这些内容是垃圾食品,那下一代AI就是在"吃自己的排泄物"。

9、这个研究的另一个惊人发现:流行度比长度更能预测"脑萎缩"效应。

在筛选垃圾数据时,他们分别测试了"只看长度"和"只看流行度"。结果发现纯长度筛选让推理能力下降10分,纯流行度筛选下降了16.6分。

"流量密码"本身就有"认知毒性"。那些最能抓住人眼球的爆款,往往是最缺乏深度、最容易上瘾、最容易让思维变浅的东西。

10、我们每天消费的信息,也是我们的"数字食物"。

你刷的那些短视频、热点新闻、朋友圈爆款...它们就像"信息垃圾食品":高热量(刺激强)、低营养(信息密度低)、易上瘾(设计就是为了让你停不下来)、长期有害。

就像垃圾食品满足口腹之欲但不提供营养,信息垃圾食品满足猎奇心和刺激需求,但不提供真正的认知价值。

11、最让人警惕的是:这种"脑萎缩"很难自我察觉。

就像长时间待在臭房间里,你会慢慢适应那个味道,甚至忘了空气本来应该是什么样。

长时间消费垃圾信息,你会慢慢适应那种"浅思考"模式,甚至忘了深度思考是什么感觉。越来越难静下心来读书,越来越不想看超过3分钟的视频,越来越习惯被动接收而不是主动思考。

但你会觉得这很正常:"大家不都这样吗?"

12、更要命的是:这种损害可能是不可逆的。

AI研究证明,即使后续补充了海量高质量数据,之前垃圾数据造成的"表征漂移"依然无法完全恢复。

人类的大脑虽然更复杂,但也有类似的问题。一旦形成"浅层思考"的习惯,神经可塑性会让你的大脑重塑,但要改回来需要巨大的意志力和时间。

13、更可怕的是,AI可能已经达到了数据质量的瓶颈。

互联网上的优质内容基本被挖完了。GPT-4训练时用了几百万本优质书籍、所有开源代码库、高质量的网页内容。但这样的优质数据是有限的。

更糟糕的是"模型崩溃"现象正在发生。AI生成的内容充斥互联网,这些内容被爬虫抓取,再用来训练下一代的AI。如果这些生成内容有偏差、有错误、缺乏深度,下一代AI就会"继承"这些问题。

这就像近亲繁殖会导致物种退化。AI可能在用自己的"语言"反复训练自己,导致思维越来越同质化、越来越浅薄。

人类还在互联网上创作优质内容,但这个比例在下降。社交媒体的爆款、AI生成的文本、批量生产的内容...这些"信息垃圾食品"正在成为主流。

14、那AI还能突破吗?

关键在于找到新的"优质数据源"。合成数据生成、强化学习从环境中学习、多模态数据融合...但这些都还在探索阶段。

现实是:人类高质量内容的生成速度,远远赶不上AI对训练数据的需求。AI在网络上"吃"到的大部分内容,都将是AI自己生成的。如果这代AI学会了"思维跳过",下一代AI可能从一开始就跳不过深度思考这一步。

这可能就是AI能力的上限——不是算力的上限,而是"食物"质量的上限。

15、这个研究重新定义了"数据质量控制"的性质。

以前我们认为数据质量是"技术问题"——如何筛选、如何清洗、如何标注。但这个研究证明,数据质量是"安全问题"——就像食品安全一样,劣质数据会在深层次上损害系统的认知健康。

对于AI,这意味着不能只追求流量和热度,需要定期进行"认知健康检查"。对于人类,这意味着不能完全依赖算法推荐,需要有意识地选择高质量的信息源。

16、最后回到人。

你如何消费信息,决定了你的思维质量;你的思维质量,决定了你的生活质量。AI吃垃圾数据会变傻,人类吃垃圾信息也会变浅。

参阅前两篇:

苏江:人类痛苦的唯一解药。

苏江:我们每天都在被千刀万剐

微信扫一扫打赏

微信扫一扫打赏

支付宝扫一扫打赏

支付宝扫一扫打赏