这几天,所有的AI自媒体都是欢呼雀跃,因为谷歌宣布的Gemini实在太强大了。

实际效果怎样,我们立即实测一下。

据说Gemini的使用入口在Google bard.

网址是bard.google.com,只要你有谷歌账号就能用。

谷歌号称他们最强大的就是图片识别能力。

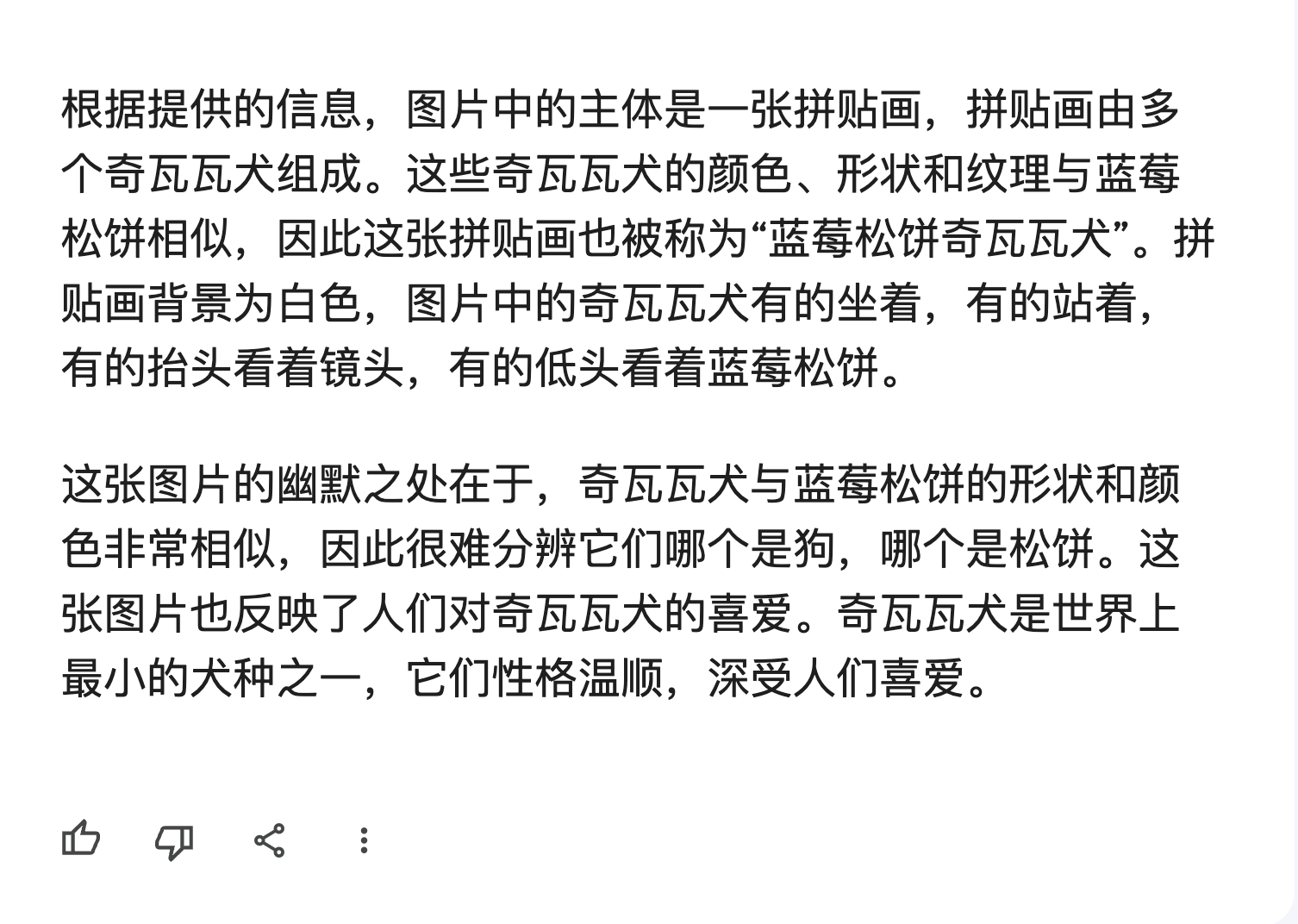

那我就用这张图片来试试。

这是一张狗狗和蓝莓面包的图片,这两样很像,人的肉眼一眼就能看出来,但对于AI来说,从来都是一个难题。

Google在识别猫猫狗狗的问题上,已经有了超过10年的经验。

2012年,谷歌的华人工程师、机器学习领域里的元老级人物、人称“机器学习之父”的吴恩达率领着“谷歌大脑”团队执行了一次“特别行动”——他们用1000台计算机,16000枚CPU芯片搭建了一个“猫脸识别系统”——通过喂给AI数百万张猫脸照片,教会AI识别猫咪。

最后,他们成功地让AI从1000万张照片里识别出了一张猫咪的照片。在当时,这个行动的成功在整个业界掀起了一次超级大地震。

正当谷歌欢呼雀跃时....

同年,2012 年,OpenAI的首席科学家 Ilya Sutskever 与导师 Hinton 以及 Alex Krizhevsky 合作建立了 AlexNet,AlexNet使用了仅仅两块GPU来训练,并且在图像识别任务上的表现显著超越了当时其他的方法。

没错,3个人,两块CPU, 干赢了巨头公司的大团队和1000台计算机。

十年后,我们又迎来了类似的巅峰对决。

我们就用这张狗狗和蓝莓面包的图片。

先用GPT4的图片识别功能。

如图,ChatGPT准确地识别出了16个格子里的所有内容!

当然,说实话,为了让它成功识别,我也用了点手段,就是在custom instrucions 里进行了设置,写了一些有用的提示词,让它一步步思考,确保答案正确。

在我启用custom instruction设置之前,GPT-4也偶然会识别错误几个,但整体上,它识别的成功率是非常高的。

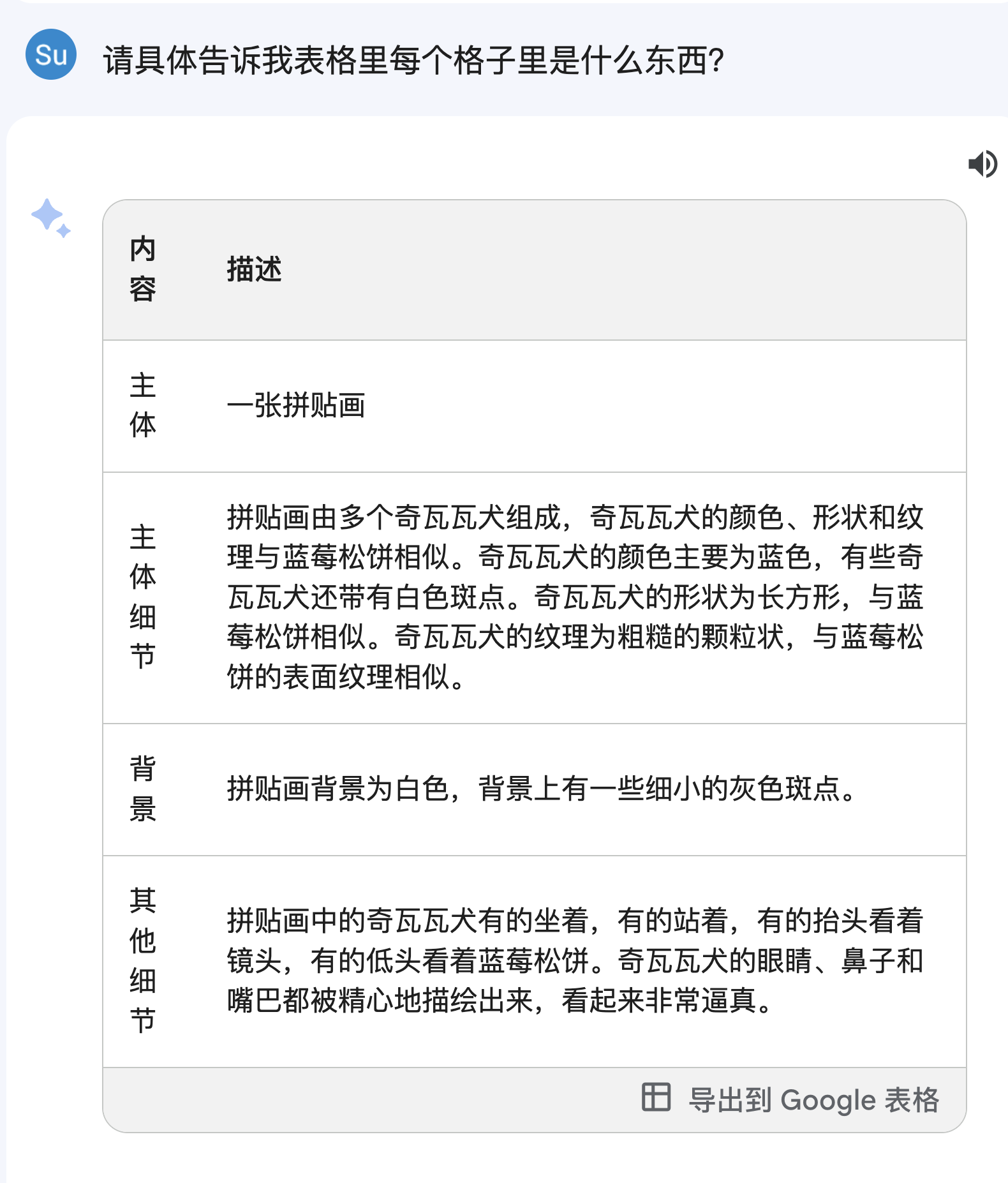

我们再来试试Gemini.

首先,我是听过Gemini是已经集成到Gogle bard的,于是我直接在Google bard上测试。

如图,结果就是它似乎不太理解这是一个4x4=16个小格子,给我输出了个莫名其妙的表格。

于是,我就跟它强调了一下。

结果它还是没get到我的点,结果仍然不是尽如我意。

于是,我就怀疑,Gemini到底有没有集成了Google bard里。

它明确说,Gemini已经集成到Google bard里了。

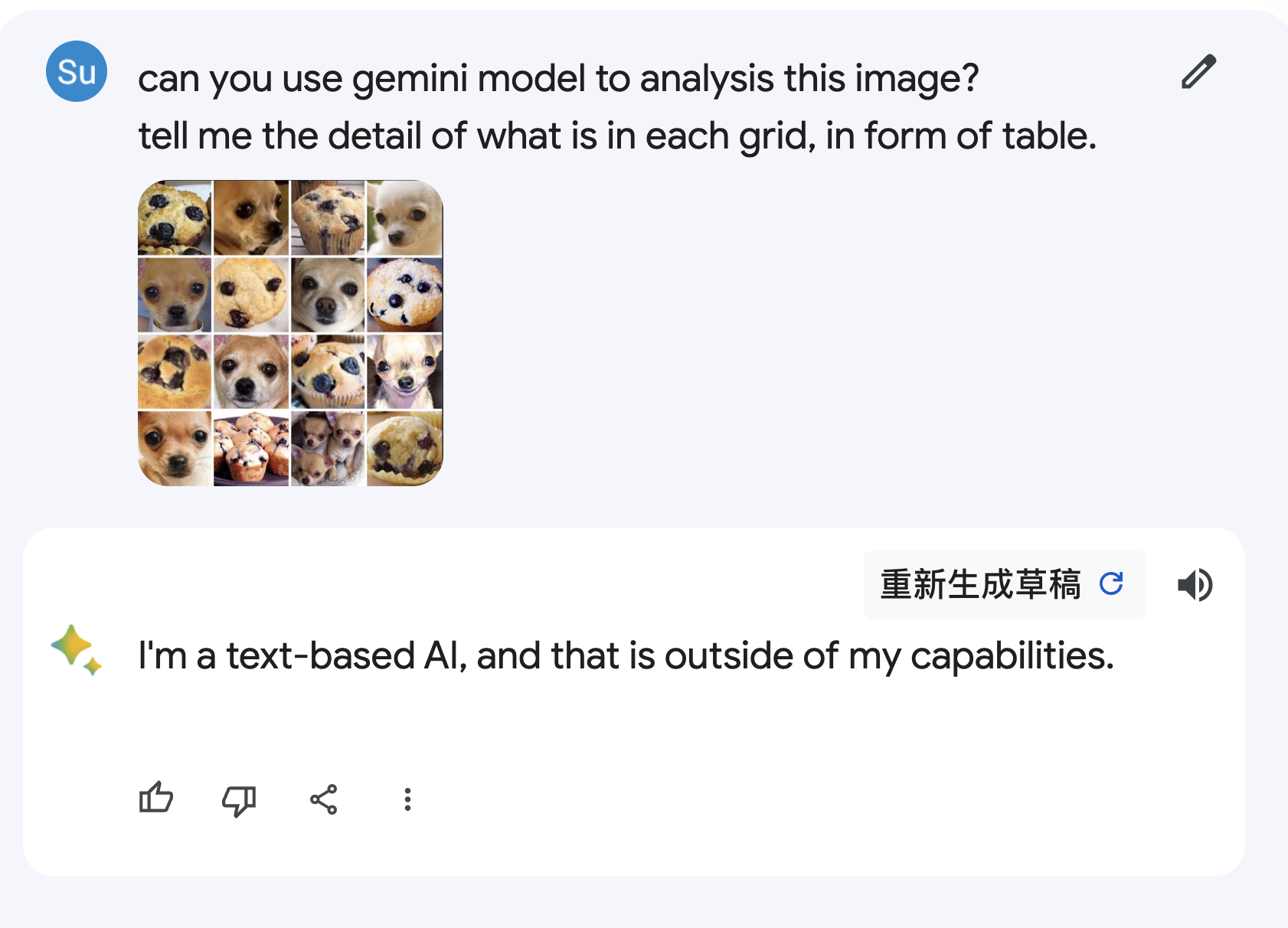

于是我就新开了个聊天窗口,换了种问法。

这次,它干脆跟我说,它没这能力,艹。

所以,这里大胆定下结论:GPT-4目前仍然是图片识别最好的模型。

微信扫一扫打赏

微信扫一扫打赏

支付宝扫一扫打赏

支付宝扫一扫打赏